Backend-Entwicklung

Backend-Entwicklung

Python-Tutorial

Python-Tutorial

Web Scraping und Parsing von HTML in Python mit Beautiful Soup

Web Scraping und Parsing von HTML in Python mit Beautiful Soup

Web Scraping und Parsing von HTML in Python mit Beautiful Soup

Jan 10, 2025 pm 12:15 PMNutzen Sie die Kraft des Web Scraping mit Python und Beautiful Soup: Ein MIDI-Musikbeispiel

Das Internet ist eine Schatzkammer an Informationen, aber der programmgesteuerte Zugriff darauf kann ohne dedizierte APIs eine Herausforderung sein. Die Beautiful Soup-Bibliothek von Python bietet eine leistungsstarke L?sung, mit der Sie Daten direkt von Webseiten extrahieren und analysieren k?nnen.

Lassen Sie uns dies untersuchen, indem wir MIDI-Daten extrahieren, um ein Magenta-Neuronales Netzwerk für die Erzeugung klassischer Nintendo-Musik zu trainieren. Wir beziehen MIDI-Dateien aus dem Video Game Music Archive (VGM).

Einrichten Ihrer Umgebung

Stellen Sie sicher, dass Python 3 und pip installiert sind. Es ist wichtig, eine virtuelle Umgebung zu erstellen und zu aktivieren, bevor Abh?ngigkeiten installiert werden:

pip install requests==2.22.0 beautifulsoup4==4.8.1

Wir verwenden Beautiful Soup 4 (Beautiful Soup 3 wird nicht mehr gepflegt).

Scraping und Parsing mit Anfragen und sch?ner Suppe

Zuerst holen wir uns den HTML-Code und erstellen ein BeautifulSoup-Objekt:

import requests from bs4 import BeautifulSoup vgm_url = 'https://www.vgmusic.com/music/console/nintendo/nes/' html_text = requests.get(vgm_url).text soup = BeautifulSoup(html_text, 'html.parser')

Das soup-Objekt erm?glicht die Navigation im HTML. soup.title gibt den Seitentitel an; print(soup.get_text()) zeigt den gesamten Text an.

Die Kraft der sch?nen Suppe meistern

Die Methoden find() und find_all() sind unerl?sslich. soup.find() zielt auf einzelne Elemente ab (z. B. erh?lt soup.find(id='banner_ad').text Banner-Werbetext). soup.find_all() iteriert durch mehrere Elemente. Dies druckt beispielsweise alle Hyperlink-URLs:

for link in soup.find_all('a'):

print(link.get('href'))

find_all() akzeptiert Argumente wie regul?re Ausdrücke oder Tag-Attribute für eine pr?zise Filterung. Weitere Informationen zu erweiterten Funktionen finden Sie in der Beautiful Soup-Dokumentation.

HTML navigieren und analysieren

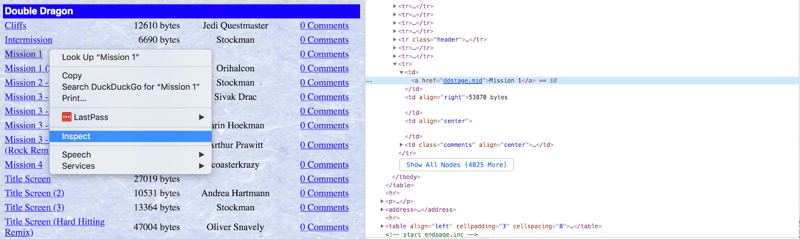

Bevor Sie Parsing-Code schreiben, prüfen Sie den vom Browser gerenderten HTML-Code. Jede Webseite ist einzigartig; Die Datenextraktion erfordert oft Kreativit?t und Experimentierfreudigkeit.

Unser Ziel ist es, einzigartige MIDI-Dateien herunterzuladen, ausgenommen Duplikate und Remixe. Browser-Entwicklertools (Rechtsklick, ?Inspizieren“) helfen dabei, HTML-Elemente für den programmgesteuerten Zugriff zu identifizieren.

Verwenden wir find_all() mit regul?ren Ausdrücken, um Links zu filtern, die MIDI-Dateien enthalten (ausgenommen solche mit Klammern im Namen):

Erstellen Sie nes_midi_scraper.py:

import re

import requests

from bs4 import BeautifulSoup

vgm_url = 'https://www.vgmusic.com/music/console/nintendo/nes/'

html_text = requests.get(vgm_url).text

soup = BeautifulSoup(html_text, 'html.parser')

if __name__ == '__main__':

attrs = {'href': re.compile(r'\.mid$')}

tracks = soup.find_all('a', attrs=attrs, string=re.compile(r'^((?!\().)*$'))

count = 0

for track in tracks:

print(track)

count += 1

print(len(tracks))

Dies filtert MIDI-Dateien, druckt ihre Link-Tags und zeigt die Gesamtzahl an. Führen Sie mit python nes_midi_scraper.py.

Herunterladen der MIDI-Dateien

Jetzt laden wir die gefilterten MIDI-Dateien herunter. Fügen Sie die Funktion download_track zu nes_midi_scraper.py:

pip install requests==2.22.0 beautifulsoup4==4.8.1

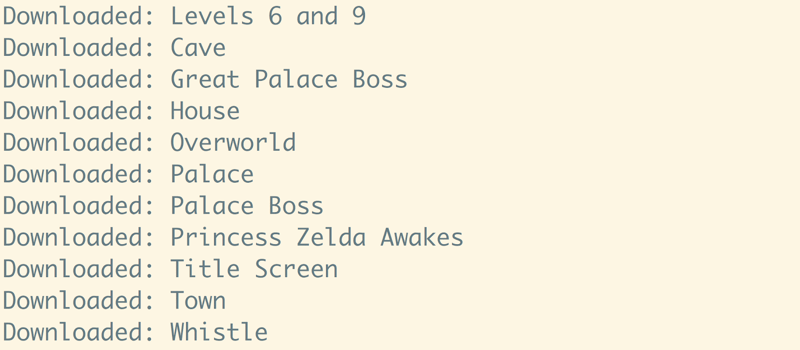

Diese Funktion l?dt jeden Titel herunter und speichert ihn unter einem eindeutigen Dateinamen. Führen Sie das Skript im gewünschten Speicherverzeichnis aus. Sie sollten ungef?hr 2230 MIDI-Dateien herunterladen (abh?ngig vom aktuellen Inhalt der Website).

Das Potenzial des Webs erkunden

Web Scraping ?ffnet Türen zu riesigen Datens?tzen. Denken Sie daran, dass Webseiten?nderungen Ihren Code besch?digen k?nnen. Halten Sie Ihre Skripte auf dem neuesten Stand. Verwenden Sie Bibliotheken wie Mido (für die MIDI-Datenverarbeitung) und Magenta (für das Training neuronaler Netzwerke), um auf dieser Grundlage aufzubauen.

Das obige ist der detaillierte Inhalt vonWeb Scraping und Parsing von HTML in Python mit Beautiful Soup. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Hei?e KI -Werkzeuge

Undress AI Tool

Ausziehbilder kostenlos

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem v?llig kostenlosen KI-Gesichtstausch-Tool aus!

Hei?er Artikel

Hei?e Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Polymorphismus in Pythonklassen

Jul 05, 2025 am 02:58 AM

Polymorphismus in Pythonklassen

Jul 05, 2025 am 02:58 AM

Der Polymorphismus ist ein Kernkonzept in der objektorientierten Programmierung von Python-Objekte und bezieht sich auf "eine Schnittstelle, mehrere Implementierungen" und erm?glicht eine einheitliche Verarbeitung verschiedener Arten von Objekten. 1. Polymorphismus wird durch Umschreiben durch Methode implementiert. Unterklassen k?nnen übergeordnete Klassenmethoden neu definieren. Zum Beispiel hat die Spoke () -Methode der Tierklasse unterschiedliche Implementierungen in Hunde- und Katzenunterklassen. 2. Die praktischen Verwendungen des Polymorphismus umfassen die Vereinfachung der Codestruktur und die Verbesserung der Skalierbarkeit, z. 3. Die Python -Implementierungspolymorphismus muss erfüllen: Die übergeordnete Klasse definiert eine Methode, und die untergeordnete Klasse überschreibt die Methode, erfordert jedoch keine Vererbung derselben übergeordneten Klasse. Solange das Objekt dieselbe Methode implementiert, wird dies als "Ententyp" bezeichnet. 4. Zu beachten ist die Wartung

Erkl?ren Sie Python -Generatoren und Iteratoren.

Jul 05, 2025 am 02:55 AM

Erkl?ren Sie Python -Generatoren und Iteratoren.

Jul 05, 2025 am 02:55 AM

Iteratoren sind Objekte, die __iter __ () und __next __ () Methoden implementieren. Der Generator ist eine vereinfachte Version von Iteratoren, die diese Methoden automatisch über das Keyword für Rendite implementiert. 1. Der Iterator gibt jedes Mal, wenn er als n?chstes anruft, ein Element zurück und wirft eine Ausnahme in der Stopperation aus, wenn es keine Elemente mehr gibt. 2. Der Generator verwendet Funktionsdefinition, um Daten auf Bedarf zu generieren, Speicher zu speichern und unendliche Sequenzen zu unterstützen. 3. Verwenden Sie Iteratoren, wenn Sie vorhandene S?tze verarbeiten, und verwenden Sie einen Generator, wenn Sie dynamisch Big Data oder faule Bewertung generieren, z. B. das Laden von Zeilen nach Zeile beim Lesen gro?er Dateien. Hinweis: Iterbare Objekte wie Listen sind keine Iteratoren. Sie müssen nach dem Erreichen des Iterators nach seinem Ende nachgebaut werden, und der Generator kann ihn nur einmal durchqueren.

Wie man mit der API -Authentifizierung in Python umgeht

Jul 13, 2025 am 02:22 AM

Wie man mit der API -Authentifizierung in Python umgeht

Jul 13, 2025 am 02:22 AM

Der Schlüssel zum Umgang mit der API -Authentifizierung besteht darin, die Authentifizierungsmethode korrekt zu verstehen und zu verwenden. 1. Apikey ist die einfachste Authentifizierungsmethode, die normalerweise in den Anforderungsheader- oder URL -Parametern platziert ist. 2. BasicAuth verwendet Benutzername und Kennwort für die Basis64 -Codierungsübertragung, die für interne Systeme geeignet ist. 3.. OAuth2 muss das Token zuerst über Client_id und Client_secret erhalten und dann das BearerToken in den Anforderungsheader bringen. V. Kurz gesagt, die Auswahl der entsprechenden Methode gem?? dem Dokument und das sichere Speichern der Schlüsselinformationen ist der Schlüssel.

Erkl?ren Sie Python -Behauptungen.

Jul 07, 2025 am 12:14 AM

Erkl?ren Sie Python -Behauptungen.

Jul 07, 2025 am 12:14 AM

Assert ist ein Inssertion -Tool, das in Python zum Debuggen verwendet wird, und wirft einen Assertionerror aus, wenn der Zustand nicht erfüllt ist. Die Syntax ist eine geltende Bedingung sowie optionale Fehlerinformationen, die für die interne Logiküberprüfung geeignet sind, z. B. Parameterprüfung, Statusbest?tigung usw., k?nnen jedoch nicht für die Sicherheits- oder Benutzereingabeprüfung verwendet werden und sollten in Verbindung mit klaren Eingabeaufforderungen verwendet werden. Es ist nur zum Hilfsdebuggen in der Entwicklungsphase verfügbar, anstatt die Ausnahmebehandlung zu ersetzen.

Wie man über zwei Listen gleichzeitig python iteriert

Jul 09, 2025 am 01:13 AM

Wie man über zwei Listen gleichzeitig python iteriert

Jul 09, 2025 am 01:13 AM

Eine gemeinsame Methode, um zwei Listen gleichzeitig in Python zu durchqueren, besteht darin, die Funktion ZIP () zu verwenden, die mehrere Listen in der Reihenfolge und die kürzeste ist. Wenn die Listenl?nge inkonsistent ist, k?nnen Sie iTertools.zip_longest () verwenden, um die l?ngste zu sein und die fehlenden Werte auszufüllen. In Kombination mit Enumerate () k?nnen Sie den Index gleichzeitig erhalten. 1.zip () ist pr?gnant und praktisch, geeignet für die Iteration gepaarte Daten; 2.zip_longest () kann den Standardwert beim Umgang mit inkonsistenten L?ngen einfüllen. 3.Enumerate (ZIP ()) kann w?hrend des Durchlaufens Indizes erhalten und die Bedürfnisse einer Vielzahl komplexer Szenarien erfüllen.

Was sind Python -Iteratoren?

Jul 08, 2025 am 02:56 AM

Was sind Python -Iteratoren?

Jul 08, 2025 am 02:56 AM

INPYTHON, ITERATORATORSAROBJECTSHATALWOULOUPING ThroughCollections Byimplementing__iter __ () und __Next __ (). 1) IteratorsworkviATheiterProtocol, verwendete __iter __ () toreturn thiteratorand__Next __ () torethentexteemtemuntemuntilstoperationSaised.2) und

Was sind Python -Typ -Hinweise?

Jul 07, 2025 am 02:55 AM

Was sind Python -Typ -Hinweise?

Jul 07, 2025 am 02:55 AM

TypHintsinpythonsolvetheProblemofAmbiguityAndpotentialbugsindynamicalpedCodeByAllowingDevelopstospecifyexpectypes

Python Fastapi Tutorial

Jul 12, 2025 am 02:42 AM

Python Fastapi Tutorial

Jul 12, 2025 am 02:42 AM

Um moderne und effiziente APIs mit Python zu schaffen, wird Fastapi empfohlen. Es basiert auf Eingabeaufforderungen an Standardpython -Typ und kann automatisch Dokumente mit ausgezeichneter Leistung generieren. Nach der Installation von Fastapi und ASGI Server Uvicorn k?nnen Sie Schnittstellencode schreiben. Durch das Definieren von Routen, das Schreiben von Verarbeitungsfunktionen und die Rückgabe von Daten kann schnell APIs erstellt werden. Fastapi unterstützt eine Vielzahl von HTTP -Methoden und bietet automatisch generierte Swaggerui- und Redoc -Dokumentationssysteme. URL -Parameter k?nnen durch Pfaddefinition erfasst werden, w?hrend Abfrageparameter durch Einstellen von Standardwerten für Funktionsparameter implementiert werden k?nnen. Der rationale Einsatz pydantischer Modelle kann dazu beitragen, die Entwicklungseffizienz und Genauigkeit zu verbessern.