Réseau neuronal à fonction de base radiale (RBFNN)

Jan 24, 2024 pm 06:45 PM

Le réseau neuronal à fonction de base radiale (RBFNN) est un modèle de réseau neuronal largement utilisé dans les problèmes de classification, de régression et de clustering. Il se compose de deux couches de neurones, la couche d’entrée et la couche de sortie. La couche d'entrée est utilisée pour recevoir le vecteur caractéristique des données et la couche de sortie est utilisée pour prédire la valeur de sortie des données. La particularité de RBFNN est que les poids de connexion entre ses neurones sont calculés via des fonctions de base radiale. La fonction de base radiale est une fonction basée sur la distance qui mesure la similarité entre les données d'entrée et les neurones. Les fonctions de base radiale couramment utilisées incluent les fonctions gaussiennes et les fonctions polynomiales. Dans RBFNN, la couche d'entrée transmet les vecteurs de caractéristiques aux neurones de la couche cachée. Les neurones de la couche cachée utilisent la fonction de base radiale pour calculer la similarité entre les données d'entrée et celles-ci et transmettent le résultat aux neurones de la couche de sortie. Couche de sortie

La couche d'entrée de RBFNN est la même que les autres modèles de réseaux neuronaux et est utilisée pour recevoir le vecteur caractéristique des données. Cependant, la couche de sortie du RBFNN est différente des autres modèles dans la mesure où elle utilise un ensemble de fonctions de base pour calculer la valeur de sortie, généralement une fonction gaussienne ou une fonction polynomiale.

Dans RBFNN, les paramètres de la fonction de base sont déterminés par entra?nement. Le processus de formation comprend deux étapes principales : la détermination du point central et le calcul des poids. Le point central est le centre de la fonction de base et est généralement déterminé à l'aide d'un algorithme de clustering. Une fois le point central déterminé, les poids peuvent être calculés en résolvant un système d'équations linéaires. De cette manière, RBFNN peut ajuster de manière adaptative les paramètres de la fonction de base grace aux données d'entra?nement, améliorant ainsi ses performances et sa précision.

Lorsque les données d'entrée arrivent à la couche d'entrée d'un réseau neuronal à fonction de base radiale (RBFNN), elles sont transmises aux fonctions de base pour traitement. Chaque fonction de base calcule la distance entre les données d'entrée et son point central et utilise cette distance comme sortie. Ces sorties sont transmises à la couche de sortie, où chaque neurone de sortie représente une catégorie ou une valeur de sortie. Chaque neurone de sortie calcule une somme pondérée des sorties de la fonction de base, et ces poids sont déterminés par le processus d'entra?nement. Enfin, la couche de sortie génère un vecteur représentant le résultat de la prédiction.

Par rapport à d'autres modèles de réseaux neuronaux, RBFNN présente les avantages suivants :

1 Vitesse de calcul rapide : Par rapport à d'autres modèles de réseaux neuronaux, la vitesse de calcul RBFNN est plus rapide car il suffit de calculer la fonction de base entre la distance. sans avoir besoin d’une multiplication matricielle complexe.

2. Le modèle a une forte interprétabilité : Le modèle RBFNN a une forte interprétabilité. Puisque les fonctions de base sont explicites, le processus de prise de décision du modèle ainsi que les résultats prédits peuvent être facilement expliqués.

3. Convient aux petits ensembles de données d'échantillons?: le modèle RBFNN convient aux petits ensembles de données d'échantillons car il peut déterminer le point central de la fonction de base grace à un algorithme de clustering, évitant ainsi le problème de surajustement.

4. Forte robustesse?: le modèle RBFNN a une bonne robustesse au bruit et aux valeurs aberrantes. Même s'il y a du bruit ou des valeurs aberrantes dans l'ensemble de données, il peut toujours donner des résultats de prédiction raisonnables.

Cependant, le modèle RBFNN présente également certaines lacunes, telles que?:

1. Exigences élevées en matière d'ensemble de données de formation?: le modèle RBFNN a des exigences élevées en matière de données de formation et doit avoir de bonnes capacités de classification ou de régression, sinon il peut provoquer un surajustement ou un sous-ajustement du modèle.

2. Le réglage des paramètres est difficile : Il existe un grand nombre de paramètres dans le modèle RBFNN, notamment le nombre de fonctions de base, la position et le poids du point central, etc.

3. Incapable de gérer les problèmes séparables non linéaires?: le modèle RBFNN ne peut pas gérer les problèmes séparables non linéaires. Dans ce cas, d'autres modèles de réseaux neuronaux plus complexes doivent être utilisés.

En bref, le réseau neuronal à fonction de base radiale est un modèle de réseau neuronal efficace, adapté aux petits ensembles de données d'échantillons et aux problèmes présentant des exigences de robustesse élevées. Cependant, il présente également certaines lacunes qui nécessitent une sélection minutieuse dans les applications pratiques.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undress AI Tool

Images de déshabillage gratuites

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Stock Market GPT

Recherche d'investissement basée sur l'IA pour des décisions plus intelligentes

Article chaud

Outils chauds

Bloc-notes++7.3.1

éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Calcul des opérandes à virgule flottante (FLOPS) pour les réseaux de neurones

Jan 22, 2024 pm 07:21 PM

Calcul des opérandes à virgule flottante (FLOPS) pour les réseaux de neurones

Jan 22, 2024 pm 07:21 PM

FLOPS est l'une des normes d'évaluation des performances informatiques, utilisée pour mesurer le nombre d'opérations en virgule flottante par seconde. Dans les réseaux de neurones, FLOPS est souvent utilisé pour évaluer la complexité informatique du modèle et l'utilisation des ressources informatiques. C'est un indicateur important utilisé pour mesurer la puissance de calcul et l'efficacité d'un ordinateur. Un réseau de neurones est un modèle complexe composé de plusieurs couches de neurones utilisées pour des taches telles que la classification, la régression et le clustering des données. La formation et l'inférence des réseaux de neurones nécessitent un grand nombre de multiplications matricielles, de convolutions et d'autres opérations de calcul, la complexité de calcul est donc très élevée. FLOPS (FloatingPointOperationsperSecond) peut être utilisé pour mesurer la complexité de calcul des réseaux de neurones afin d'évaluer l'efficacité d'utilisation des ressources de calcul du modèle. FIASCO

Explorez les concepts, les différences, les avantages et les inconvénients de RNN, LSTM et GRU

Jan 22, 2024 pm 07:51 PM

Explorez les concepts, les différences, les avantages et les inconvénients de RNN, LSTM et GRU

Jan 22, 2024 pm 07:51 PM

Dans les données de séries chronologiques, il existe des dépendances entre les observations, elles ne sont donc pas indépendantes les unes des autres. Cependant, les réseaux de neurones traditionnels traitent chaque observation comme indépendante, ce qui limite la capacité du modèle à modéliser des données de séries chronologiques. Pour résoudre ce problème, le réseau neuronal récurrent (RNN) a été introduit, qui a introduit le concept de mémoire pour capturer les caractéristiques dynamiques des données de séries chronologiques en établissant des dépendances entre les points de données du réseau. Grace à des connexions récurrentes, RNN peut transmettre des informations antérieures à l'observation actuelle pour mieux prédire les valeurs futures. Cela fait de RNN un outil puissant pour les taches impliquant des données de séries chronologiques. Mais comment RNN parvient-il à obtenir ce type de mémoire ? RNN réalise la mémoire via la boucle de rétroaction dans le réseau neuronal. C'est la différence entre RNN et le réseau neuronal traditionnel.

Une étude de cas sur l'utilisation du modèle LSTM bidirectionnel pour la classification de texte

Jan 24, 2024 am 10:36 AM

Une étude de cas sur l'utilisation du modèle LSTM bidirectionnel pour la classification de texte

Jan 24, 2024 am 10:36 AM

Le modèle LSTM bidirectionnel est un réseau neuronal utilisé pour la classification de texte. Vous trouverez ci-dessous un exemple simple montrant comment utiliser le LSTM bidirectionnel pour les taches de classification de texte. Tout d'abord, nous devons importer les bibliothèques et modules requis?: importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Em

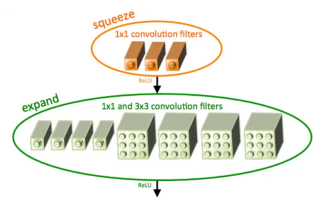

Introduction à SqueezeNet et ses caractéristiques

Jan 22, 2024 pm 07:15 PM

Introduction à SqueezeNet et ses caractéristiques

Jan 22, 2024 pm 07:15 PM

SqueezeNet est un algorithme petit et précis qui établit un bon équilibre entre haute précision et faible complexité, ce qui le rend idéal pour les systèmes mobiles et embarqués aux ressources limitées. En 2016, des chercheurs de DeepScale, de l'Université de Californie à Berkeley et de l'Université de Stanford ont proposé SqueezeNet, un réseau neuronal convolutif (CNN) compact et efficace. Ces dernières années, les chercheurs ont apporté plusieurs améliorations à SqueezeNet, notamment SqueezeNetv1.1 et SqueezeNetv2.0. Les améliorations apportées aux deux versions augmentent non seulement la précision, mais réduisent également les co?ts de calcul. Précision de SqueezeNetv1.1 sur l'ensemble de données ImageNet

Débruitage d'image à l'aide de réseaux de neurones convolutifs

Jan 23, 2024 pm 11:48 PM

Débruitage d'image à l'aide de réseaux de neurones convolutifs

Jan 23, 2024 pm 11:48 PM

Les réseaux de neurones convolutifs fonctionnent bien dans les taches de débruitage d'images. Il utilise les filtres appris pour filtrer le bruit et restaurer ainsi l'image originale. Cet article présente en détail la méthode de débruitage d'image basée sur un réseau neuronal convolutif. 1. Présentation du réseau neuronal convolutif Le réseau neuronal convolutif est un algorithme d'apprentissage en profondeur qui utilise une combinaison de plusieurs couches convolutives, des couches de regroupement et des couches entièrement connectées pour apprendre et classer les caractéristiques de l'image. Dans la couche convolutive, les caractéristiques locales de l'image sont extraites via des opérations de convolution, capturant ainsi la corrélation spatiale dans l'image. La couche de pooling réduit la quantité de calcul en réduisant la dimension des fonctionnalités et conserve les principales fonctionnalités. La couche entièrement connectée est responsable du mappage des fonctionnalités et des étiquettes apprises pour mettre en ?uvre la classification des images ou d'autres taches. La conception de cette structure de réseau rend les réseaux de neurones convolutifs utiles dans le traitement et la reconnaissance d'images.

Comparez les similitudes, les différences et les relations entre la convolution dilatée et la convolution atreuse

Jan 22, 2024 pm 10:27 PM

Comparez les similitudes, les différences et les relations entre la convolution dilatée et la convolution atreuse

Jan 22, 2024 pm 10:27 PM

La convolution dilatée et la convolution dilatée sont des opérations couramment utilisées dans les réseaux de neurones convolutifs. Cet article présentera en détail leurs différences et leurs relations. 1. Convolution dilatée La convolution dilatée, également connue sous le nom de convolution dilatée ou convolution dilatée, est une opération dans un réseau neuronal convolutif. Il s'agit d'une extension basée sur l'opération de convolution traditionnelle et augmente le champ récepteur du noyau de convolution en insérant des trous dans le noyau de convolution. De cette fa?on, le réseau peut mieux capturer un plus large éventail de fonctionnalités. La convolution dilatée est largement utilisée dans le domaine du traitement d'images et peut améliorer les performances du réseau sans augmenter le nombre de paramètres ni la quantité de calcul. En élargissant le champ de réception du noyau de convolution, la convolution dilatée peut mieux traiter les informations globales dans l'image, améliorant ainsi l'effet d'extraction de caractéristiques. L'idée principale de la convolution dilatée est d'introduire quelques

réseau neuronal convolutif causal

Jan 24, 2024 pm 12:42 PM

réseau neuronal convolutif causal

Jan 24, 2024 pm 12:42 PM

Le réseau neuronal convolutif causal est un réseau neuronal convolutif spécial con?u pour les problèmes de causalité dans les données de séries chronologiques. Par rapport aux réseaux de neurones convolutifs conventionnels, les réseaux de neurones convolutifs causals présentent des avantages uniques en ce qu'ils conservent la relation causale des séries chronologiques et sont largement utilisés dans la prédiction et l'analyse des données de séries chronologiques. L'idée centrale du réseau neuronal convolutionnel causal est d'introduire la causalité dans l'opération de convolution. Les réseaux neuronaux convolutifs traditionnels peuvent percevoir simultanément les données avant et après le point temporel actuel, mais dans la prévision des séries chronologiques, cela peut entra?ner des problèmes de fuite d'informations. Parce que le résultat de la prédiction à l’heure actuelle sera affecté par les données à l’heure future. Le réseau neuronal convolutionnel causal résout ce problème. Il ne peut percevoir que le point temporel actuel et les données précédentes, mais ne peut pas percevoir les données futures.

Réseau de neurones jumeaux?: analyse des principes et des applications

Jan 24, 2024 pm 04:18 PM

Réseau de neurones jumeaux?: analyse des principes et des applications

Jan 24, 2024 pm 04:18 PM

Le réseau neuronal siamois est une structure de réseau neuronal artificiel unique. Il se compose de deux réseaux de neurones identiques partageant les mêmes paramètres et poids. Dans le même temps, les deux réseaux partagent également les mêmes données d’entrée. Cette conception a été inspirée par des jumeaux, car les deux réseaux de neurones sont structurellement identiques. Le principe du réseau neuronal siamois est d'accomplir des taches spécifiques, telles que la correspondance d'images, la correspondance de textes et la reconnaissance de visages, en comparant la similitude ou la distance entre deux données d'entrée. Pendant la formation, le réseau tente de mapper des données similaires vers des régions adjacentes et des données différentes vers des régions distantes. De cette manière, le réseau peut apprendre à classer ou à faire correspondre différentes données pour obtenir des résultats correspondants.